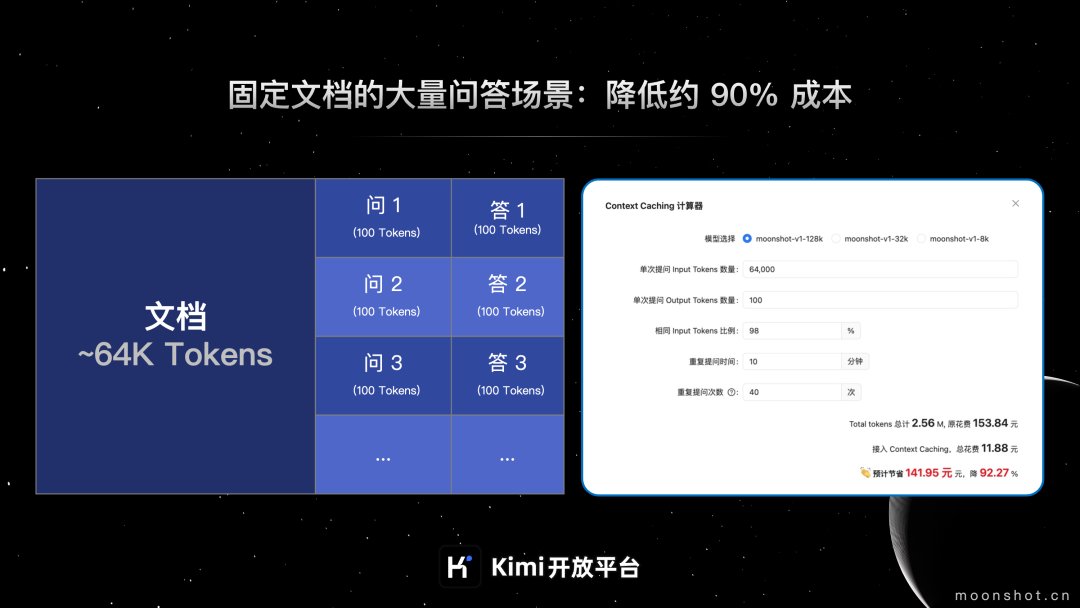

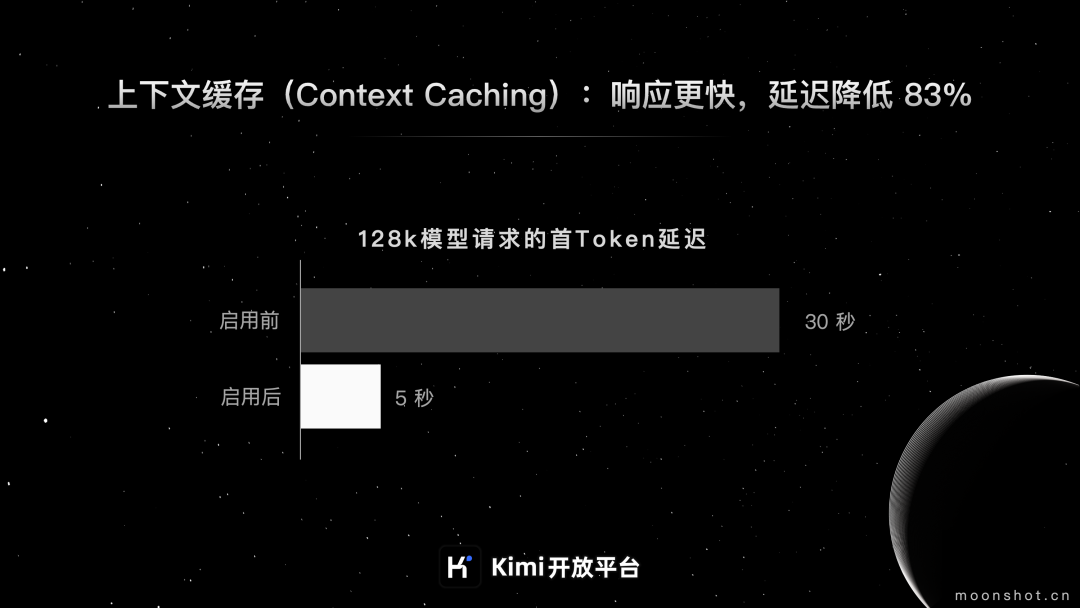

Kimi 开放平台上下文缓存功能公测:降低最高 90% 的使用成本

嘿,你知道吗?这个月的 2 号,有个叫做 Kimi 的系统助手开放了上下文缓存的功能,现在正在公测呢!这个功能特别适合那些经常需要请求、引用大量初始上下文的场景,可以帮你省下不少长文本模型的费用,还能加快模型的响应速度哦!据说,费用最多能降个 90%,首 Token 的延迟也能减少 83% 呢!这可是个大大的好消息啊!

系统助手附 Kimi 开放平台上下文缓存功能公测详情如下:

技术简介

据介绍,上下文缓存是一种数据管理技术,允许系统预先存储会被频繁请求的大量数据或信息。当用户请求相同信息时,系统可以直接从缓存中提供,无需重新计算或从原始数据源中检索。

适用场景

适用业务场景如下:

提供大量预设内容的 QA Bot,例如 Kimi API 小助手

针对固定的文档集合的频繁查询,例如上市公司信息披露问答工具

对静态代码库或知识库的周期性分析,例如各类 Copilot Agent

瞬时流量巨大的爆款 AI 应用,例如哄哄模拟器,LLM Riddles

交互规则复杂的 Agent 类应用等

计费说明

上下文缓存收费模式主要分为以下三个部分:

Cache 创建费用

调用 Cache 创建接口,成功创建 Cache 后,按照 Cache 中 Tokens 按实际量计费。24 元 / M token

Cache 存储费用

Cache 存活时间内,按分钟收取 Cache 存储费用。10 元 / M token / 分钟

Cache 调用费用

Cache 调用增量 token 的收费:按模型原价收费

Cache 调用次数收费:Cache 存活时间内,用户通过 chat 接口请求已创建成功的 Cache,若 chat message 内容与存活中的 Cache 匹配成功,将按调用次数收取 Cache 调用费用。0.02 元 / 次

公测时间和资格说明

公测时间:功能上线后,公测 3 个月,公测期价格可能随时调整。

公测资格:公测期间 Context Caching 功能优先开放给 Tier5 等级用户,其他用户范围放开时间待定。

以上是系统助手提供的最新资讯,感谢您的阅读,更多精彩内容请关注系统助手官网。

系统下载排行榜71011xp

番茄花园Win7 64位推荐旗舰版 V2021.05

2深度技术Win7 64位豪华旗舰版 V2021.07

3最新Win7虚拟机镜像文件 V2021

4番茄花园Win7 64位旗舰激活版 V2021.07

5带USB3.0驱动Win7镜像 V2021

6系统之家 Ghost Win7 64位 旗舰激活版 V2021.11

7萝卜家园Win7 64位旗舰纯净版 V2021.08

8雨林木风Win7 SP1 64位旗舰版 V2021.05

9技术员联盟Win7 64位旗舰激活版 V2021.09

10萝卜家园Ghost Win7 64位极速装机版 V2021.04

深度技术Win10 64位优化专业版 V2021.06

2深度技术Win10系统 最新精简版 V2021.09

3Win10超级精简版 V2021

4Win10完整版原版镜像 V2021

5风林火山Win10 21H1 64位专业版 V2021.06

6Win10光盘镜像文件 V2021

7深度技术 Ghost Win10 64位 专业稳定版 V2021.11

8技术员联盟Ghost Win10 64位正式版 V2021.10

9Win10 21H1 Build 19043.1320 官方正式版

10技术员联盟Win10 64位永久激活版镜像 V2021.07

系统之家 Ghost Win11 64位 官方正式版 V2021.11

2Win11PE网络纯净版 V2021

3系统之家Ghost Win11 64位专业版 V2021.10

4Win11官网纯净版 V2021.10

5Win11 RTM版镜像 V2021

6番茄花园Win11系统64位 V2021.09 极速专业版

7Win11官方中文正式版 V2021

8Win11专业版原版镜像ISO V2021

9Win11 22494.1000预览版 V2021.11

10番茄花园Win11 64位极速优化版 V2021.08

深度技术Windows XP SP3 稳定专业版 V2021.08

2雨林木风Ghost XP Sp3纯净版 V2021.08

3萝卜家园WindowsXP Sp3专业版 V2021.06

4雨林木风WindowsXP Sp3专业版 V2021.06

5风林火山Ghost XP Sp3纯净版 V2021.08

6技术员联盟Windows XP SP3极速专业版 V2021.07

7萝卜家园 Windows Sp3 XP 经典版 V2021.04

8番茄花园WindowsXP Sp3专业版 V2021.05

9电脑公司WindowsXP Sp3专业版 V2021.05

10番茄花园 GHOST XP SP3 纯净专业版 V2021.03

热门教程 更多+

装机必备 更多+

重装教程 更多+

电脑教程专题 更多+